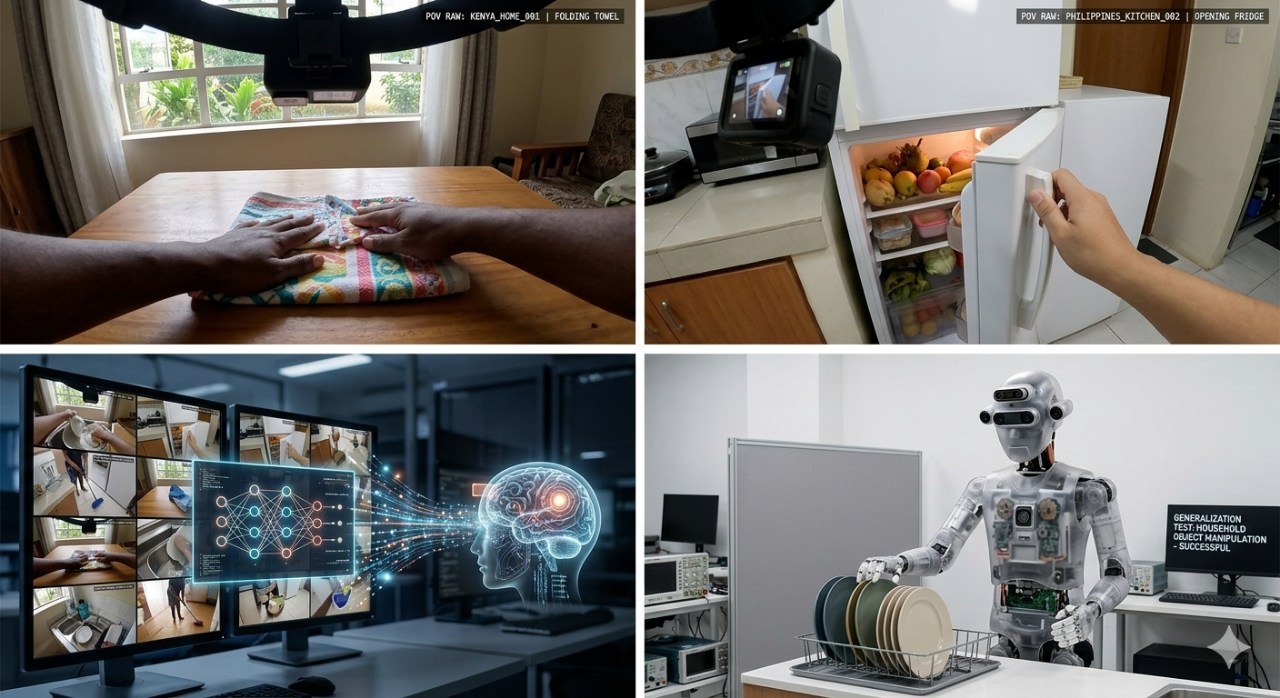

近期,科技媒体《麻省理工科技评论》(MIT Technology Review)披露了一项正在全球范围内大规模展开的奇特工程:初创公司 Micro1 正在几十个国家招募人员,要求他们佩戴第一人称视角的摄像头(如智能眼镜或头戴式运动相机),记录下自己折叠毛巾、打开冰箱、洗碗、拖地等日常家务的全过程。

如果你只关注大语言模型(LLMs)如何写诗或生成代码,你可能会对这种极其"低科技"的录像行为感到不解。然而,在硅谷最顶尖的机器人实验室里,这些充满生活琐碎的视频录像,正是目前极其稀缺、价值连城的"工业原油"。

为了让 AI 从数字世界走向现实,科技巨头们正在构建一个前所未有的庞大数据库。这并不是一次无意义的记录,而是一场旨在攻克人工智能最终堡垒的"物理世界数据淘金热"。

莫拉维克悖论与"物理世界的常识"

要理解 Micro1 为什么需要这些视频,我们首先要面对人工智能领域著名的"莫拉维克悖论"(Moravec’s paradox):对于 AI 而言,实现人类的高阶逻辑推理(如国际象棋、写微积分方程)非常容易,但实现人类一岁小孩的感知和运动控制能力(如抓起一个柔软的毛巾、在杂乱的房间里走路)却难如登天。

目前的 AI 已经通过吞噬互联网上的海量文本,掌握了人类的语言逻辑。但问题在于,"物理世界的常识"并没有写在维基百科上。

- 一个装满水的玻璃杯有多重?

- 湿抹布擦过桌面的摩擦力是多少?

- 折叠一件棉质T恤和一件丝绸衬衫时,手指需要施加的力度有何不同?

这些人类依靠肌肉记忆和直觉就能完成的动作,包含了极其复杂的隐性物理规律。大模型无法通过"阅读"学会洗碗,它们需要通过视觉和动作的强映射来学习。Micro1 收集的这些做家务的视频,本质上就是在为 AI 编写一本《人类物理世界交互指南》。

为什么不使用虚拟仿真?Sim2Real 难题

在过去,机器人学家通常在虚拟环境(Simulation,如 Mujoco、Isaac Gym)中训练机器人的动作。他们会在电脑里建一个厨房,让虚拟的机械臂在里面千万次地练习抓取。

但虚拟训练面临着一个难以逾越的技术鸿沟:Sim2Real Gap(从仿真到现实的差距)。

1. 软体动力学(Soft Body Dynamics)的计算灾难

在电脑里模拟一个刚性物体(如铁块)很容易,但模拟"柔软"的物体极其困难。一块被水浸湿、揉成一团的毛巾,其物理形变包含了几百万个变量,现有的物理引擎根本无法做到 100% 精确的实时模拟。

2. 现实世界的"噪音"与混乱

虚拟环境是理想化的,但现实世界充满了不可控变量:清晨与黄昏厨房光线的折射、水龙头水流的随机飞溅、旧冰箱门轴的阻力变化。

既然"自上而下"的物理模拟走到了瓶颈,AI 科学家们决定转向"自下而上"的数据暴力美学:直接从真实世界中采集海量的人类演示数据(Human Demonstration Data)。让机器人在看过了几万次真实厨房里的光影、几万次真实的毛巾折叠后,自己去提取其中的物理特征。

第一人称视角(Egocentric Vision)的技术奥秘

Micro1 的任务要求中有一个关键细节:工作人员必须佩戴摄像头录制。这在计算机视觉领域被称为"第一人称视角数据"(Egocentric Vision Data)。

为什么不能用固定在墙上的监控摄像头来录?因为 AI 需要学习的是"具身"(Embodied)的视角。

1. 视线与注意力的对齐

当一个人走向冰箱时,头戴式摄像头的画面中心往往就是他的视觉焦点(比如冰箱门把手)。这给 AI 提供了一个极其明确的"注意力机制(Attention Mechanism)"训练信号:在执行"开门"这个动作时,系统应该将计算资源集中在画面的哪个区域。

2. 视觉-语言-动作模型(VLA)的直接映射

未来的机器人头上也会顶着摄像头。人类戴着摄像头记录的视频,其视角与机器人未来的工作视角几乎完全重合。通过这种第一人称视频,结合大规模的"模仿学习"(Imitation Learning),AI 能够更顺畅地将"眼睛看到的像素(Vision)"和"人类大脑下达的任务(Language)“转化为对应的"空间坐标与机械控制指令(Action)”。

走向全球的初衷——对抗"长尾效应"的绝对多样性

Micro1 的数据采集足迹遍布肯尼亚、菲律宾、印度、巴西等50多个国家。抛开其他因素,单从机器学习的技术维度来看,这是一种为了获取绝对数据多样性(Data Diversity)的必然选择。

如果所有的家务数据都在美国加州的样板房里录制,AI 就会发生严重的过拟合(Overfitting)。它可能只认得双开门的不锈钢大冰箱,只认得洗碗机和特定的美式餐具。一旦把它放到一个环境截然不同的家庭中,它就会彻底宕机。

现实世界存在无穷无尽的边缘情况(Edge Cases / 长尾效应):

- 印度的厨房可能有着不同形状的香料罐和独特的厨具(如塔瓦平底锅)。

- 巴西的家庭可能有着不同材质的瓷砖地板和独特的光照条件。

- 不同气候国家的家庭,其衣物的材质和折叠方式也大相径庭。

只有吸纳全球各地、各种光线、各类杂乱程度、各种物品布局的视觉数据,具身智能模型才能提取出真正的"泛化能力"(Generalization)。它需要明白,"门把手"不仅有金属的、木头的,还有圆的、扁的、甚至是有破损的;只要它满足特定的视觉特征和空间逻辑,机器人就应该知道如何去握住它。

结语:构建物理世界的 ImageNet

回顾深度学习的历史,2012 年,一个名为 ImageNet 的庞大图像数据库(包含上千万张带标签的图片)引发了计算机视觉的大爆炸,直接开启了这一轮 AI 浪潮。

今天,像 Micro1 这样在全球收集家务视频的行动,本质上就是在为物理世界构建一个全新的、动态的、包含动作信息的 “具身智能版 ImageNet”。

这是一项浩大的技术基建工程。当数以千万小时计的拖地、洗碗、叠衣服的第一人称视频被清洗、标注并输入到巨大的神经网络中时,那些冰冷的机械臂和人形机器人,正在以硅基的速度,快速理解我们这个复杂、柔软且充满摩擦力的真实世界。看似平平无奇的家务录像,正是通往下一代通用人工智能(AGI)的基石。