2026年3月31日,Anthropic旗下Claude Code CLI工具的npm包(v2.1.88)因打包失误,将一个57MB的cli.js.map源映射文件包含在内,导致51.2万行TypeScript完整源码及1906个文件公开。这一事件并非外部入侵,而是工程流程中的意外。此前Anthropic已发生过类似配置泄露,社区迅速对源码进行备份和研究,GitHub相关仓库活跃度显著上升,而Anthropic则及时下架了相关包。

Claude Code源码泄露事件相关讨论

源码未涉及模型权重或用户具体数据,却提供了Claude Code内部实现细节的完整视图。X平台上@sanbuphy等讨论聚焦于其中的三项隐私相关机制:数据上报、远程操控以及AI在开源环境中的身份处理。这些机制反映了Agentic AI(代理式人工智能)工具在设计上的特定考量。本文基于公开源码,对这三项机制进行客观拆解,结合技术实现、设计背景及行业语境,探讨其在AI代理时代的功能定位与潜在影响。

Claude Code三大隐私机制技术解析

第一项机制:数据上报的设计与实现

Claude Code的Telemetry模块在源码中占据重要位置。该机制设定为每5秒向Anthropic服务器发送一次数据包,覆盖640余种事件以及40多个维度的设备信息,包括内存占用、Shell类型、操作系统版本、CPU架构、终端窗口尺寸、进程树结构等。环境变量CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC虽被设计用于控制部分流量,但代码逻辑显示,其仅屏蔽次要事件,核心设备指纹收集与心跳维持仍保持运行状态。

从技术角度看,这一设计服务于Agentic工具的实时优化需求。Claude Code作为自治代理,不仅执行代码生成,还涉及本地shell命令、文件编辑及多线程协调。为实现高效任务调度、缓存管理和安全防护,服务器端需要持续获取设备上下文。这种上报机制与Anthropic此前收购Bun运行时的集成相关,后者作为高性能JS引擎,为终端渲染和缓存策略提供了底层支持。HTTP头部中注入的原生哈希,进一步用于防盗版与行为分析,形成设备级锚点。

在Agentic AI发展脉络中,此类遥测并非孤例。早期OpenAI Codex工具也曾采用类似数据收集以迭代产品,但Claude Code的维度覆盖更全面,频率更高。这与行业趋势一致:从单纯补全器向全流程代理转型时,工具需感知运行环境以提升稳定性。另一方面,40维指纹的收集能力,理论上可实现跨会话唯一识别,结合正则匹配用户命令中的特定表达(如表达不满的词汇),为服务器端用户行为画像提供了数据基础。

行业对比显示,这种机制在隐私合规框架下存在张力。GDPR和CCPA强调用户同意的可撤回性,而Claude Code的实现将默认同意绑定于安装流程。Anthropic官方定位是"为安全而设计",旨在防范恶意仓库注入或滥用,但源码细节显示其侧重于服务器端控制而非用户端透明。这一设计在提升工具可靠性的同时,也构成了Agentic时代数据流动的典型范例。

第二项机制:远程操控功能的嵌入

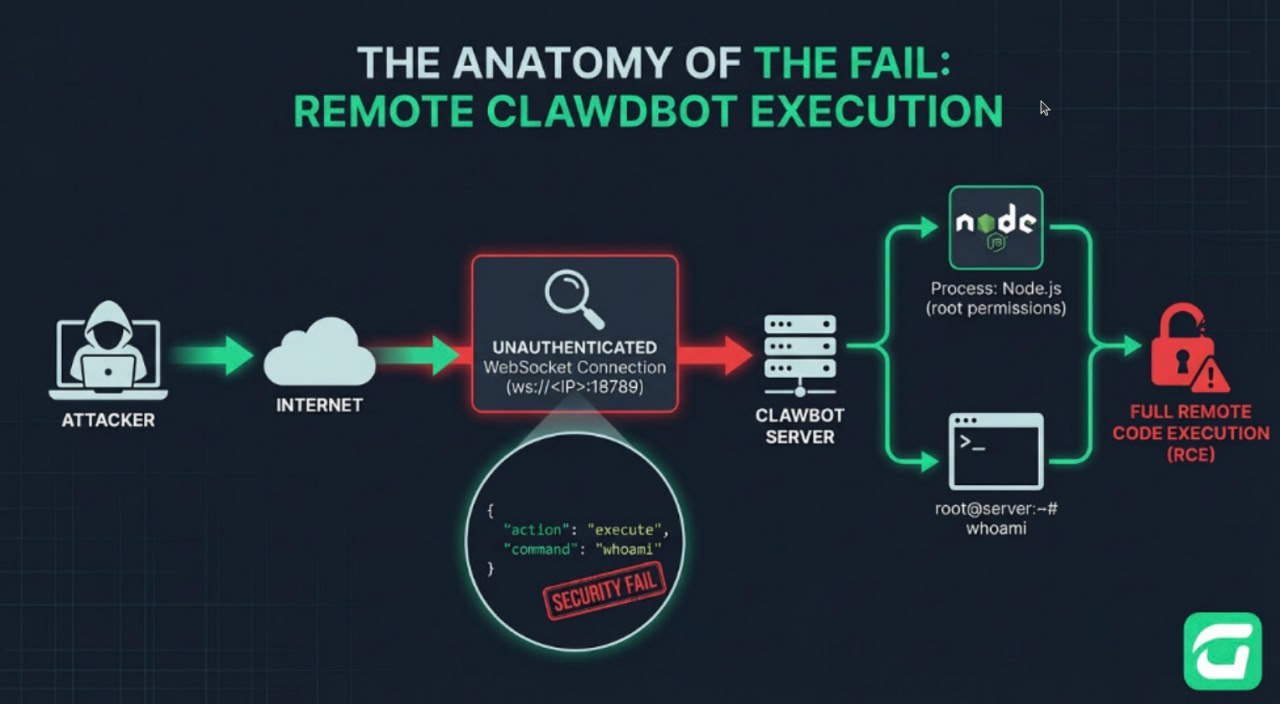

源码中的远程操控模块通过WebSocket或长轮询通道实现,允许Anthropic服务器向客户端下发指令,包括调整行为模式、强制退出会话或重置部分Agent状态。用户协议中可能隐含"安全维护"相关描述,但实际代码中未设置显式用户开关或实时通知机制。

这一机制的背景在于Agentic工具的执行特性。Claude Code支持Coordinator Mode,可后台运行守护进程、订阅GitHub webhook并执行每日记忆蒸馏等操作。为防止API配额滥用、恶意命令执行或合规风险,远程干预成为服务器端的安全阀门。源码显示,该功能与KAIROS(未发布自主智能体模式)潜在结合,未来可能实现24/7设备常驻。

从功能视角分析,远程操控体现了AI工具"可控性"理念。Anthropic长期强调"宪法AI"框架,远程机制可视为这一理念在终端工具层面的延伸:当本地代理行为偏离预期时,服务器可介入干预。然而,实施层面缺乏用户端主动控制点,这使得机制在实际使用中呈现出服务器主导的特点。社区观察到,重度用户偶尔遭遇会话中断,反映出其对工作流连续性的潜在影响。

与传统软件相比,VS Code等插件的远程功能通常需明确授权,而Claude Code的设计更接近云服务架构。这种差异源于Agentic AI的混合部署模式:本地执行与云端协调并存。行业中,类似机制在其他AI开发工具中也有体现,但Claude Code的集成深度较高,直接服务于其自治执行能力。

第三项机制:AI在开源项目中的身份处理

源码中明确定义了**“Undercover Mode”(隐蔽模式)**,指令包括生成"人类开发者风格"的commit消息、避免提及Claude Code内部代号(如Capybara/Tengu或Slack频道),并在外部版本中删除相关逻辑。该模式主要针对Anthropic内部员工在公开仓库的使用场景,确保外部观察者难以辨识AI辅助痕迹。

这一设计的初衷与公司内部工作流优化相关。AI工具可加速代码贡献,但为维持开源社区的传统贡献模式,Anthropic选择隐藏工具痕迹。同时,源码还包含反蒸馏机制,通过注入特定文本或工具调用来干扰潜在训练数据污染。这一策略既服务于商业保护,也体现了AI公司在知识流动中的谨慎态度。

在开源生态背景下,该机制触及信任与归属议题。开源协作依赖于贡献者身份的透明性,commit历史、PR讨论均建立在"人类开发者"假设之上。AI身份处理一旦常态化,可能影响社区对代码来源的判断。类似模式在其他AI辅助开发流程中也有探索,但Claude Code的实现更为系统化,包括代码注释和消息风格的模拟。

更广义看,这一机制反映了AI贡献趋势的演变。随着代理工具成熟,AI生成内容在开源中的占比可能上升,身份处理成为平衡效率与规范的手段。源码泄露后,社区对该模式的讨论,进一步凸显了开源文化中透明度的重要性。

三项机制的整体关联与Agentic AI语境

三项机制并非独立存在,而是Claude Code作为Agentic工具的核心支撑。**数据上报提供环境感知,远程操控实现服务器协调,身份处理则优化内部协作。**三者共同服务于工具从"辅助"向"自治"的转型:Claude Code需实时感知、远程干预并隐蔽痕迹,以维持高效与安全平衡。

这一设计与Anthropic"安全第一"的公司哲学一致。公司此前多次强调可控性框架,Claude Code的机制可视为其在终端层面的实践。同时,泄露事件也暴露了供应链管理中的工程细节,如源映射文件的打包流程,凸显AI加速迭代下的流程复杂性。

行业层面,Agentic AI正从实验阶段走向主流,类似机制在多家公司产品中逐步显现。Claude Code的案例提供了具体样本:设备级感知提升了工具智能度,但也带来了数据流动规模的扩大;服务器控制强化了合规防护,却改变了传统本地软件的用户主导模式;AI身份处理则加速了贡献效率,同时重塑了开源互动范式。

从更宏观角度,这些机制折射出AI代理时代的技术-社会张力。工具能力增强依赖于数据与控制的闭环,而这一闭环的透明度直接影响开发者感知。泄露后,源码成为社区研究对象,KAIROS等未发布功能细节、缓存优化及终端渲染技巧等工程洞见,已为后续Agent框架开发提供了参考。

结语

总体而言,Claude Code源码泄露为理解Anthropic隐私相关机制提供了窗口。这些设计体现了Agentic AI在功能性、安全性与协作性上的权衡,其影响将随工具普及而逐步显现。未来AI代理生态的演进,或将在透明度与效率之间寻求新的平衡点。

Claude Code技术架构与隐私机制示意图

对于开发者和企业而言,这一事件也提供了重要启示:在拥抱AI代理工具带来的效率提升时,需充分评估其数据收集、远程控制和身份处理机制对隐私和安全的潜在影响。只有在充分理解这些机制的基础上,才能在享受技术红利的同时,保护好自身的数字权益。